近日,正值新春佳節(jié)之際,阿里云震撼發(fā)布了其最新的通義千問Qwen 2.5-Max超大規(guī)模MoE模型。用戶現(xiàn)在可以通過API接口輕松訪問該模型,或直接登錄Qwen Chat平臺,享受與模型對話、使用artifacts以及搜索等一系列功能。

據(jù)了解,通義千問Qwen 2.5-Max采用了超過20萬億token的龐大預訓練數(shù)據(jù),并結(jié)合了精細的后訓練方案,以確保其卓越的性能。

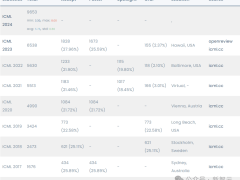

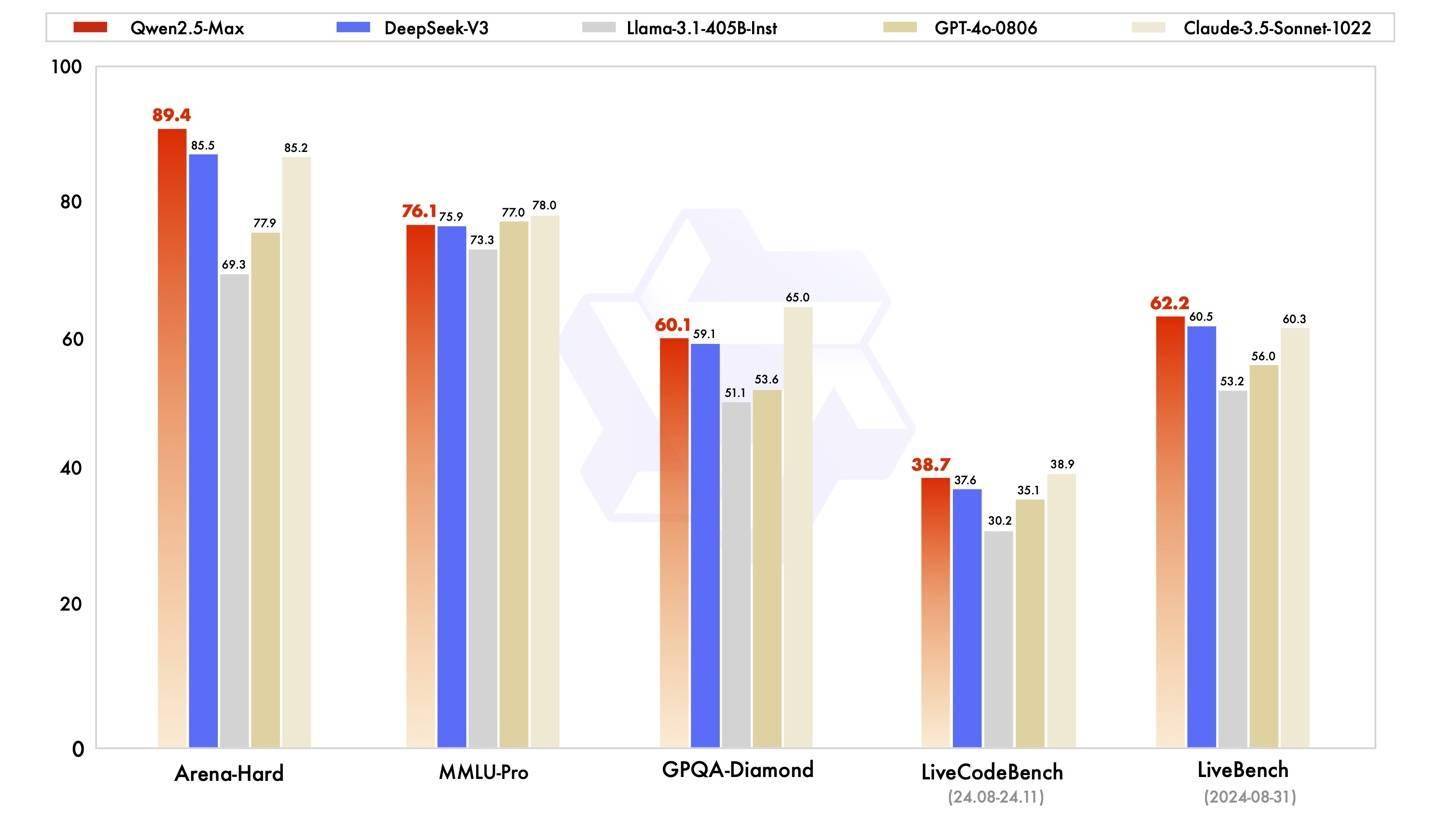

在性能展示方面,阿里云將通義千問Qwen 2.5-Max與業(yè)界知名的指令模型進行了對比,包括DeepSeek V3、GPT-4o和Claude-3.5-Sonnet。結(jié)果顯示,Qwen 2.5-Max在Arena-Hard、LiveBench、LiveCodeBench和GPQA-Diamond等多項基準測試中,均超越了DeepSeek V3,并且在MMLU-Pro等其他評估中也展現(xiàn)出了強大的競爭力。

在基座模型的對比中,由于無法獲取GPT-4o和Claude-3.5-Sonnet等閉源模型的基座信息,阿里云選擇了與當前領(lǐng)先的開源MoE模型DeepSeek V3、最大的開源稠密模型Llama-3.1-405B,以及同樣位列開源稠密模型前列的Qwen2.5-72B進行對比。結(jié)果顯示,Qwen2.5-Max的基座模型在大多數(shù)基準測試中均展現(xiàn)出了顯著的優(yōu)勢。

這一系列的對比測試充分證明了通義千問Qwen 2.5-Max的強大實力。隨著后訓練技術(shù)的不斷突破,我們有理由相信,未來的Qwen2.5-Max將會達到更加令人矚目的水平,為用戶帶來更加智能、高效的體驗。