近日,清華大學(xué)沈陽團(tuán)隊的新作《DeepSeek攻略》再度引起廣泛關(guān)注,本次攻略深度探討了AI領(lǐng)域的一個獨(dú)特現(xiàn)象——AI幻覺。

許多用戶在體驗(yàn)DeepSeek等大語言模型時,或許都曾遭遇過看似言之鑿鑿,實(shí)則與事實(shí)大相徑庭的回答。這些回答,正是AI幻覺的一種體現(xiàn)。

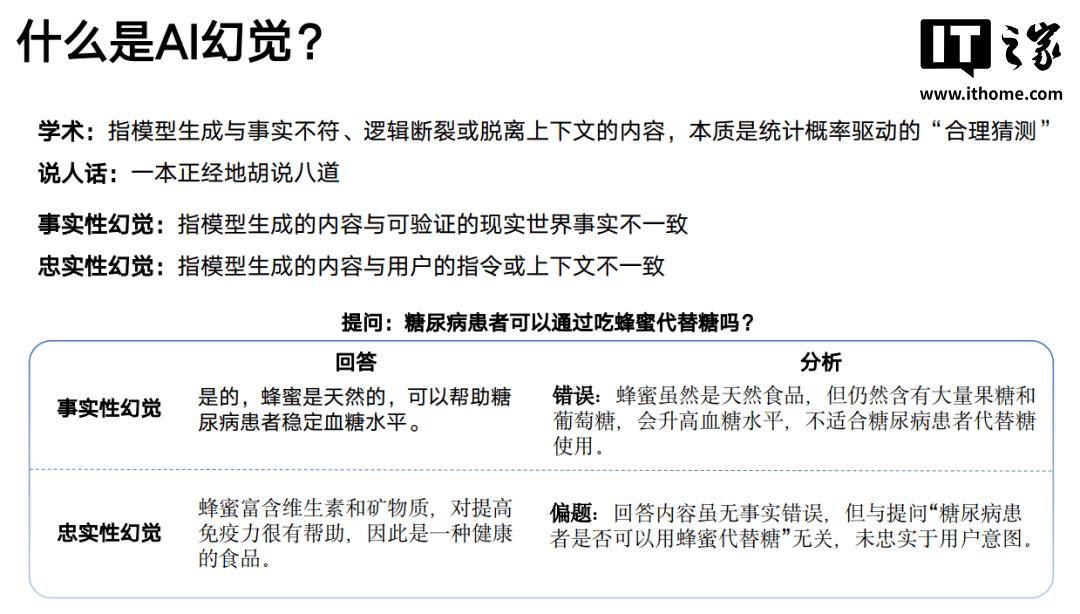

在《DeepSeek攻略》的第五部分中,詳細(xì)解析了AI幻覺這一概念。AI幻覺,簡而言之,即模型生成的內(nèi)容與實(shí)際情況不符,邏輯斷裂或脫離上下文。這些“不合理”的輸出,其實(shí)是統(tǒng)計概率驅(qū)動下的“合理猜測”。

AI幻覺主要分為兩類:事實(shí)性幻覺與忠實(shí)性幻覺。前者指的是模型生成的內(nèi)容與可驗(yàn)證的現(xiàn)實(shí)世界事實(shí)不一致;后者則是模型生成的內(nèi)容與用戶的指令或上下文存在偏差。

那么,為何會產(chǎn)生AI幻覺呢?原因主要有以下幾點(diǎn):數(shù)據(jù)偏差導(dǎo)致模型放大了訓(xùn)練數(shù)據(jù)中的錯誤或片面性;泛化困境使得模型難以處理訓(xùn)練集外的復(fù)雜場景;知識固化讓模型過度依賴參數(shù)化記憶,缺乏動態(tài)更新能力;意圖誤解則在用戶提問模糊時,讓模型容易“自由發(fā)揮”。

為了減緩AI幻覺的影響,作為普通用戶,我們可以采取一些措施。例如,開啟聯(lián)網(wǎng)搜索功能,讓AI對齊信息顆粒度,減少“胡說八道”的幾率。在編寫提示詞時,提前做好知識邊界的限定,降低模型虛構(gòu)的可能性。使用多款A(yù)I模型進(jìn)行交叉驗(yàn)證,也是一個有效的方法。

盡管AI幻覺在現(xiàn)階段仍無法完全杜絕,但它在某些領(lǐng)域卻具有創(chuàng)造力價值。對于需要創(chuàng)新思維的領(lǐng)域,AI幻覺或許能激發(fā)新的靈感。當(dāng)然,要讓AI幻覺的“想象力”為我們所用,還需要逐步建立方法論,并經(jīng)過合理的驗(yàn)證過程。

本次分享的《DeepSeek攻略》PDF版本為原汁原味的原版,避免了網(wǎng)上眾多被魔改、內(nèi)置廣告的版本,為讀者提供了更加純凈的閱讀體驗(yàn)。