meta Ray-Ban meta 智能眼鏡近日迎來了其v11版本的重大更新,為用戶帶來了一場前所未有的智能交互體驗革新。此次更新的最大亮點,莫過于引入了“實時 AI”(Live AI)功能,這一創新技術將率先在參與“早期體驗計劃”的用戶中得以應用。

在過去,meta AI僅能通過拍攝靜態圖片并進行分析來回應用戶的“Hey meta”指令。而v11版本的“實時 AI”功能,則實現了對用戶視野的持續觀察,并能以更加自然流暢的方式與用戶進行對話。這一功能的實現,意味著用戶無需再使用特定的喚醒詞,即可隨時向AI提出問題,而AI也能根據用戶的上下文進行記憶和回應。

在“實時 AI”會話期間,眼鏡會實時錄制并分析用戶所見的內容。用戶可以隨時打斷AI的講述,提出新的問題或更改話題,而AI也能在用戶提問之前主動提供有用的建議。這種交互方式,無疑為用戶帶來了更加便捷和智能的使用體驗。

meta的“實時 AI”功能與谷歌的Gemini Live在對話式AI方面有著異曲同工之妙,兩者都支持打斷和記憶查詢。然而,與Gemini Live需要依賴手機不同,meta的“實時 AI”功能允許用戶完全解放雙手,只需通過眼鏡即可與AI進行交互。

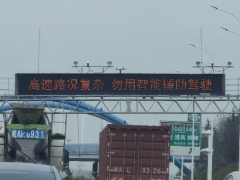

除了“實時 AI”功能外,v11版本還帶來了“實時翻譯”的實用功能。用戶可以通過這一功能,與不同語言背景的人進行無障礙交流。無論是英語、西班牙語、法語還是意大利語,用戶都能通過手機屏幕查看對方的回復,或通過Ray-Ban meta眼鏡的揚聲器收聽翻譯結果。

v11版本還集成了Shazam音樂識別功能。用戶只需簡單地說一句“Hey meta,Shazam這首歌”,就能輕松識別出周圍播放的音樂。這一功能的加入,無疑為用戶在享受音樂時提供了更多的便利和樂趣。

對于想要立即體驗這些新功能的用戶來說,他們可以通過注冊“早期體驗計劃”來率先嘗鮮。而未能加入該計劃的用戶,則需要等到2025年初的正式版本發布后才能體驗到這些創新功能。用戶可以通過meta View應用程序的設置菜單輕松加入“早期體驗計劃”,享受這場智能交互體驗的革新之旅。

近幾個月來,meta在AI技術方面不斷推陳出新,為用戶帶來了諸多實用的更新。例如,meta AI現在可以“記住”用戶的一些特定信息(如停車地點),并拍攝相關照片以創建后續提醒。這些功能的加入,無疑進一步提升了meta智能眼鏡的實用性和用戶體驗。